Las universidades de Jaén y Málaga trabajan en una nueva generación de robots sociales que se encargarán del cuidado de ancianos en entornos domotizados.

¿Y si en unos años hubiera robots que se encargasen de atender a personas mayores? ¿Y si estos androides tuvieran la capacidad para comunicarse con esas personas y establecer relaciones empáticas con ellas? ¿Y si una nueva generación de robots sociales dirigiera ejercicios mentales y físicos cuando estimen que sean necesarios?

Estamos a las puertas de una revolución que protagonizarán los robots sociales, capaz de cambiar la manera en que nos relacionamos con las máquinas y, de alguna manera, ocupar el vacío dejado en el cuidado de ancianos impuesto por los modelos de familia actuales.

Un nuevo escenario con robots sociales

El cambio está muy cercano, de hecho se espera que en poco tiempo un robot social ayudará en la tarea a los equipos de cuidadores y de enfermeros, en un entorno altamente domotizado, donde el droide actuará como un interfaz amigable y cercano a las personas que lo utilizarán.

Este robot será el resultado de un proyecto financiado con fondos estatales, en el que están implicadas las universidades de Jaén, Málaga, Extremadura, Castilla La Mancha y Carlos III de Madrid, y con el que se persigue crear una nueva generación de robots que lleguen a comunicarse mejor con las personas que los rodean.

Imitan la comunicación humana

La clave de este proyecto reside en la comunicación, y no precisamente entre los diferentes elementos electrónicos que lo componen o con el entorno inteligente en el que trabajará, sino mejorar la manera de entablar relación con las personas a las que servirá, explican expertos de las universidades de Jaén y de Málaga implicados en este proyecto.

Hasta la fecha, los aspectos más técnicos son conocidos y no representan un gran problema para estos expertos, que cuentan con una trayectoria dilatada en el ámbito de la robótica. El gran reto, explica el investigador de la Universidad de Málaga, Antonio Bandera, pasa por ver a estos robots “desde fuera”, es decir, desde el punto de vista del usuario final, para hacerlos lo más ‘humanos’ posible. Y no precisamente en su aspecto físico, sino en la manera en que estas máquinas se relacionarán con las personas, que en este caso, se tratará de ancianos, en un principio, poco acostumbrados a las nuevas tecnologías y que pueden mostrar bastante extrañeza ante estos nuevos productos desarrollados en los laboratorios de ingeniería de estas universidades.

Los investigadores deben cambiar su condición de tecnólogos para ponerse en el lugar de los usuarios del robot y ver de qué manera pueden hacerlo más amigable.

El robot, desde el punto de vista del usuario

“El robot se pone delante de una persona y no siempre actúa como esa persona espera. Ahora estamos trabajando en ver el robot desde fuera, en intentar capturar desde el punto de vista del usuario, cómo debe funcionar el robot. El robot inicia la conversación, se presenta de una determinada forma… Tiene que ver con los aspectos técnicos, pero ahora los vemos desde fuera”, explica Antonio Bandera.

Y para que esta función más cercana a la de los seres humanos se realice correctamente, el robot debe ‘ver y oír’ perfectamente. En este sentido, los ingenieros van mucho más allá de dotar a los robots de unos micrófonos con la sensibilidad adecuada para percibir las órdenes de las personas, o de unas cámaras que actúen como el ojo humano ante cualquier tipo de luz. Los robots están obligados a comportarse como los humanos, a saber dirigir su atención o su ‘mirada’, si cabe esta capacidad en un droide, a quien les habla. A localizarle en el espacio en función de la procedencia del sonido… “a fusionar audio y visión tal y como hacemos las personas”, dice el investigador del grupo Multimedia and Multimodal Processing de la Universidad de Jaén, Pedro Jesús Reche.

Los investigadores de esta universidad han encargado del diseño de un nuevo modelo de interacción con las personas, que mejoran los mecanismos de atención de los robots sociales, para que sean capaces de “atender” a una persona, reconocer quién está hablando dentro de una habitación, seguirla con la mirada e interactuar con ella.

Presta atención al usuario y lo sigue con la ‘mirada’

Diseñan el software que dote al robot de los mecanismos necesarios para “prestar atención” y poder comunicarse con sus usuarios. “Lo que hacemos básicamente es trabajar en el procesado multimodal para permitir que el robot pueda procesar distintos tipos de información, audio y visual, y así mejorar su capacidad de interacción”, explica Pedro Reche.

Para ello, los investigadores trabajan en un sistema de procesado que fusiona la información visual que recibe el robot a través de las cámaras con la información auditiva que recibe a través de los micrófonos. “La idea es que el robot tenga comportamientos socialmente aceptables”, añade.

Según destaca Pedro Reche, dependiendo del uso que se vaya a hacer del robot, éste puede incorporar una o varias cámaras de vídeo, así como uno o diversos sensores de audio.

Imitación de la visión humana

“Si quieres que el robot pueda tener conciencia de la profundidad que hay en el espacio no vale con una sola cámara, se necesitan al menos dos, al igual que el ser humano tiene dos ojos para calcular mejor el espacio”.

En este sentido, los ingenieros de la Universidad de Jaén se inspiran en la propia biología humana para conseguir estas habilidades, aunque la manera de conseguirlo, desde el punto de vista tecnológico, es distinta y a veces permite incluso superar las dotes humanas.

El diseño de este modelo de procesado de información permite al robot “interpretar” lo que ve y lo que oye, y por lo tanto interactuar con las personas. La meta es conseguir que este robot trabaje con personas mayores dentro de un entorno inteligente dotado con sensores y otros mecanismos que lo ayuden a desenvolverse.

“En robótica hemos avanzado mucho, pero aún queda trabajo por hacer y a veces hay expectativas muy altas de lo que se puede conseguir. Todos hemos visto películas que pueden tender a la confusión”, recalca el experto. Así, uno de los principales retos para la robótica es precisamente mejorar su capacidad de interacción social, algo que en la práctica se consigue dotando al autómata de “sentidos”, para poder registrar lo que ve y escucha, y de “inteligencia”, para poder interpretarlo.

Librerías de código abierto y un número de frases limitado

Los investigadores de la Jaén han apostado por utilizar librerías de código abierto y desarrollar un corpus textual para el robot. Es decir, un conjunto de frases y expresiones que se producen un contexto determinado, ya que las órdenes que recibirá serán muy concretas y posiblemente se muevan solamente en un conjunto reducido de frases y expresiones. Es una manera de limitar la capacidad del robot, cierto, pero de lo que se trata, dice Pedro Reche, es de reducir el margen de error, gracias a que los reconocedores de voz tendrán un funcionamiento más depurado y avanzado.

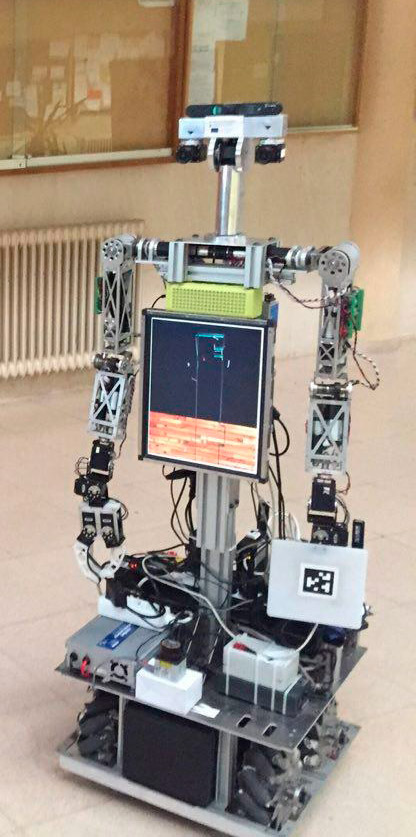

El equipo de Pedro Reche ha empleado sistemas tan populares como Kinect, que emplea la consola Xbox 360 para los juegos accionados por el movimiento real del usuario. Y también trabajan con un middleware, un software para interactuar y comunicarse con otros elementos electrónicos u otras aplicaciones, ya que el entorno ideal del robot es el de un espacio domotizado, dotado de una serie de sensores que controlarán parámetros muy diversos.

Cuerpo extremeño y sentidos de Jaén y Málaga

El hardware del robot, es decir, el cuerpo lo desarrolla la Universidad de Extremadura, que ha partido desde cero, con un autómata que guarda cierta similitud con Pepper, de la firma SoftBank Robotics, cuyo coste se mueve entre los 14.400 euros de la versión académica y los 19.900 que vale el modelo más avanzado diseñado para empresas. Sin embargo, tal y como explica Antonio Bandera, el diseño definitivo no está totalmente decidido, ya que dependerá de las funciones a las que se vaya a destinar.

En un principio, el robot cumplirá dos funciones fundamentales. Una que los investigadores llaman “bring me” o tráeme, en inglés. El robot está equipado con unos brazos y unas manos para agarrar objetos y llevárselos a los usuarios. La segunda función definida por los investigadores es la que denominan “let’s go” o vamos, por la que este droide propone ejercicios físicos o mentales a los usuarios.

Estas dos funciones son las que vienen definidas en el proyecto financiado por el Estado y en el que participan estas universidades andaluzas. Pero podrían ser más, ya que la programación podría hacerse a medida, en función de las necesidades de los usuarios finales.

Al mismo tiempo, el grupo de la Universidad de Málaga está trabajando en otro proyecto europeo en colaboración con investigadores franceses, lo que les ha permitido disponer de otras dos plataformas robóticas, éstas derivadas de productos que ya están en el mercado.

Robots parecidos a los que hay en el mercado

En el fondo, todas se parecen mucho “por dentro y por fuera”, matiza Bandera, y que la clave del trabajo con las tres plataformas está conseguir un comportamiento parecido al de los humanos.

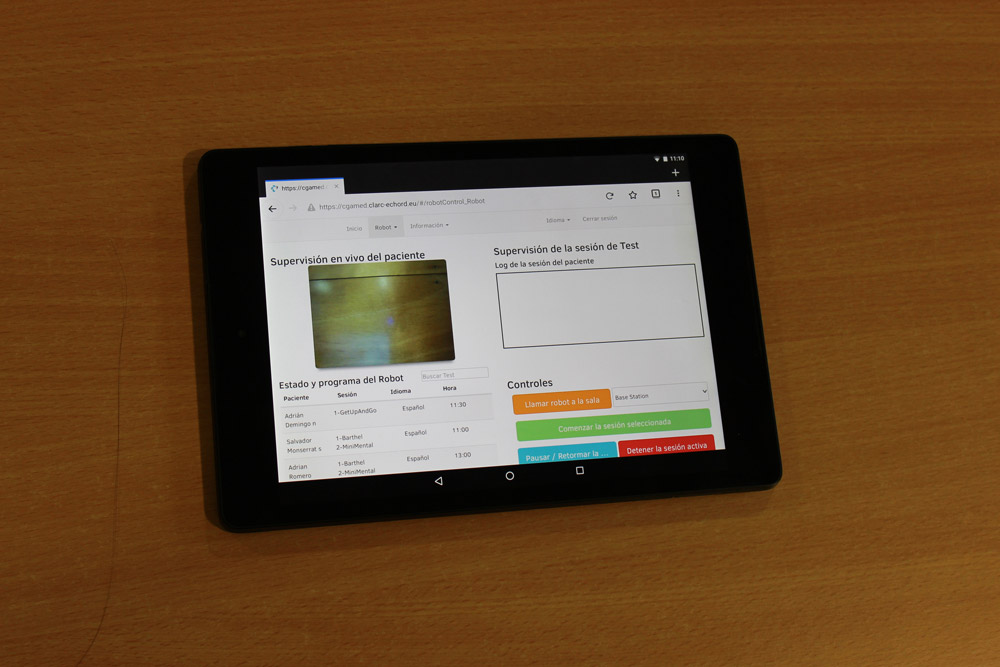

“Si hasta hace un tiempo los problemas eran técnicos, del tipo de que el robot debe ser capaz de moverse en un entorno donde hay personas, no puede chocar, debe localizar a los usuarios, ajustar las cámaras, controlar la luz… el problema se ha salido de ahí y está a otro nivel: cómo le habla a la persona, le enseña un mensaje u otro, primero le pregunta… Se está integrando el robot en un ecosistema más amplio, porque está pensado para trabajar en un entorno determinado, en unas habitaciones con sensores y el robot podría recoger toda esa información”, dice el investigador de la Universidad de Málaga.

Robots sociales en entornos domotizados

El droide tendrá una autonomía menor a la de otros, en la medida en que funcionará como un interfaz en un entorno domotizado o inteligente, y tomaría decisiones a partir no solo de lo que percibe, sino también con la información que llega de sensores externos, que pueden ser de temperatura, humedad, presencia de personas, y otros sensores que podrían llevar las propias personas y que darían información de sus constantes vitales o incluso de si han sufrido una caída.

Los investigadores barajan la posibilidad de subir algunos de sus recursos a la nube, que estén fuera del robot e interactúen también con todos los elementos electrónicos integrados en ese espacio inteligente.

En resumidas cuentas, el robot sería la cara y la sonrisa de ese espacio domotizado. El encargado de interactuar con las personas, de ahí que el trabajo de los investigadores de Málaga y de Jaén estén centrado en el desarrollo de sistemas de interacción con personas, más que en el trabajo con el hardware, del que se encargan los investigadores de las otras universidades participantes en el proyecto.

Trabajo con personas mayores

El escenario ideal para este robot es un espacio inteligente, en el que hay unas veinte o treinta personas acostumbradas a la presencia de esta máquina. Este dato parece banal, pero tiene mucha trascendencia, ya que resulta crucial que las personas, sobre todo si son mayores, se acostumbren a la presencia del robot y a la interacción con él.

“Muchas veces sorprende la facilidad para acostumbrarse a la tecnología y el robot prestaría servicios como propuestas de juegos para ejercitar la mente, responder a preguntas de los usuarios del tipo de cuál es el menú o tener el control de las personas que hay en el entorno de trabajo, proponer ejercicio físico si detecta que la persona está mucho tiempo en el mismo sitio sin hacer nada… al final se convierte en una herramienta de los cuidadores, muy capacitada para recoger datos de los usuarios de la residencia en cuestión y monitoriza. Puede hacer tests a los usuarios de la residencia, de forma que sería una herramienta de recabar información”.

El próximo mes de septiembre se contará con los primeros ejemplares “piloto”, que servirán para perfilar sus funciones y realizar ajustes a su comportamiento. A partir de las pruebas en los entornos reales se calibrarán sus funciones y su aspecto, en función de las necesidades de los usuarios, porque si por algo destacan estos robots es por el amplio abanico de posibilidades que ofrecen.

Y se abrirá un tiempo nuevo en el que los robots pasarán a formar parte de nuestro entorno cotidiano. Es una realidad vista hasta ahora solamente en las películas de ciencia ficción que, como en muchas ocasiones, se ha vuelto a adelantar a la realidad. Y de esa realidad están formando parte activa universidades del sur de España como Jaén y Málaga.